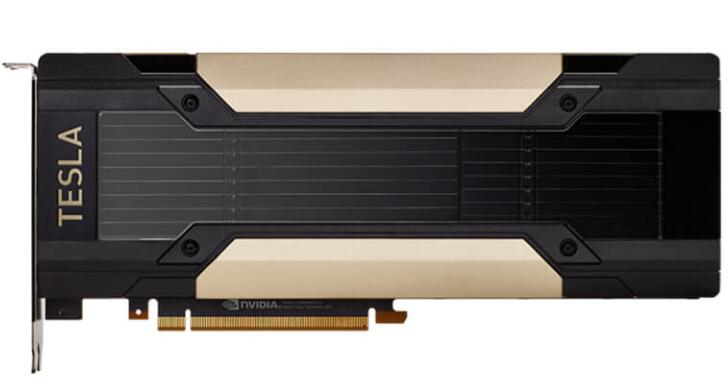

NVIDIA V100显卡自2017年推出以来,一直是科研、深度学习训练和高性能计算的首选之一。基于Volta架构的V100显卡,凭借其强大的CUDA核心和Tensor核心,以及高速HBM2显存,在深度学习训练、科学计算和大数据处理等场景中表现出色。

V100显卡基本算力介绍

NVIDIA V100显卡主要面向数据中心和科研级用户,拥有5120个CUDA核心和640个Tensor核心。其设计目标是提供高吞吐量和低延迟的浮点计算能力。具体来说,V100显卡的浮点性能可以分为单精度(FP32)、双精度(FP64)和半精度(FP16)三类指标:

单精度浮点(FP32)算力

V100在FP32模式下的理论峰值算力约为14 TFLOPS(万亿次浮点运算每秒)。这意味着显卡每秒能够处理大约14000亿次单精度计算,非常适合深度学习训练中的卷积操作和矩阵计算。在大规模神经网络训练中,FP32算力是最常用的参考指标。

双精度浮点(FP64)算力

V100在FP64模式下的理论峰值算力约为7 TFLOPS。FP64通常用于科学计算、工程模拟和金融建模等对精度要求极高的任务。相比FP32.FP64的算力较低,但能够保证计算结果的高精度。

星宇智算官网GPU显卡服务器租赁,AI应用一键部署免费试用!

半精度浮点(FP16)和Tensor核心算力

V100显卡的Tensor核心专门优化了FP16混合精度计算。在FP16模式下,理论算力可达到112 TFLOPS,这也是V100在深度学习训练中表现卓越的重要原因。利用Tensor核心进行矩阵乘法和卷积运算,可以大幅加速神经网络训练,同时显存占用较低,适合大模型训练。

除了这些浮点计算性能,V100显卡还支持INT8和INT4整数运算,这对于推理和量化模型非常有帮助,能够在保持模型精度的同时提高推理速度。

显存与算力的关系

V100显卡提供16GB或32GB HBM2显存,两者在算力表现上略有差异,但主要影响的是可处理的数据规模和训练大模型的能力。显存越大,可以一次性加载更多的训练数据和模型参数,从而减少显存交换和数据传输延迟,间接提升实际训练算力。

对于16GB版本的V100.适合中小规模模型和数据集训练,FP32、FP64和FP16理论算力与32GB版本相似,但在实际大模型训练中,可能需要分批次处理数据。32GB版本显卡则更适合大模型训练,如BERT、GPT系列等大型预训练模型,可以一次性加载整个模型,提高训练效率。

V100显卡实际性能表现

虽然理论算力非常吸引人,但在实际使用中,V100的算力会受到任务类型、显存利用率、数据传输效率和软件优化的影响。深度学习训练中,如果使用TensorFlow或PyTorch等框架充分利用Tensor核心,V100可以接近其FP16理论峰值算力。但在一些不适合FP16的任务或者科学计算中,实际性能通常低于理论峰值。

另外,多卡并行训练也是常见场景。V100支持NVLink高速互联,可以实现多卡数据并行和模型并行,进一步提升训练速度。通过合理的任务划分和通信优化,多卡V100集群可以处理超大规模深度学习模型,算力呈线性甚至超线性增长。

V100算力对比与适用场景

虽然V100已经发布多年,但其算力在许多中小规模任务中依然足够使用。相比后续的A100和H100.V100的理论峰值略低,但价格也相对合理。V100特别适合以下场景:

科研计算:如分子模拟、天气预测、流体力学计算等,需要大量浮点计算的科学任务。

深度学习训练:尤其是中大型神经网络训练,利用FP16混合精度和Tensor核心可以显著加速训练过程。

企业AI推理:支持FP16、INT8量化推理,适合部署模型进行实时推理。

多卡集群训练:通过NVLink实现高带宽互联,适合大规模深度学习模型训练。

总的来说,V100算力足以满足科研和工业应用的绝大部分需求,同时在预算上比最新A100和H100更加亲民。

常见问题(FAQ)

问:V100显卡的FP32算力是多少?

答:理论峰值约为14 TFLOPS,适合深度学习训练和科学计算。

问:V100显卡的FP64算力是多少?

答:理论峰值约为7 TFLOPS,适合需要高精度计算的科学和工程任务。

问:V100显卡的FP16算力有多高?

答:利用Tensor核心,FP16理论峰值可达112 TFLOPS,非常适合大规模深度学习训练。

问:16GB和32GB版本的算力有区别吗?

答:理论算力相似,但32GB版本显存更大,能处理更大模型和数据集,实际训练效率更高。

问:V100显卡适合深度学习新手吗?

答:适合,但价格较高。个人开发者可以考虑云端V100实例或二手卡。

问:V100可以用于AI推理吗?

答:可以,尤其是FP16和INT8模式下的推理性能非常高,适合企业部署。

问:V100算力能跑GPT类大模型吗?

答:可以,但单卡受显存限制,大模型训练通常需要多卡并行或分布式训练。

问:V100显卡算力会随时间下降吗?

答:理论算力不会下降,但使用寿命过长、散热不良或长期高负荷可能导致性能不稳定,需要注意保养。

问:V100和A100算力差别大吗?

答:A100在FP32、FP64和FP16算力上均高于V100.尤其在FP16和Tensor核心性能上提升显著,适合最新大模型训练需求。

问:多卡V100能提升算力吗?

答:可以,通过NVLink互联,多卡并行可以显著提升整体训练速度和吞吐量,但需要合理的软件优化。

NVIDIA V100显卡凭借其高达14 TFLOPS的FP32算力、7 TFLOPS的FP64算力和112 TFLOPS的FP16 Tensor核心算力,仍然是科研、深度学习和高性能计算领域的可靠选择。16GB和32GB版本分别适合中小型模型和大型模型训练,实际性能受显存利用率、软件优化和任务类型影响。对于科研机构和企业,V100显卡在价格和算力之间提供了平衡点;对于个人开发者,二手市场或云计算服务可以让你以较低成本体验V100算力。通过充分利用Tensor核心和多卡并行,V100显卡依然可以在当今深度学习训练和科学计算中发挥重要作用。