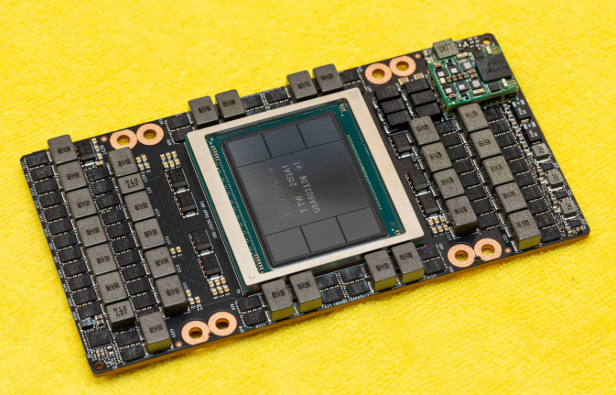

NVIDIA H100 是目前数据中心和人工智能领域中极具代表性的高端计算显卡之一,基于 Hopper 架构设计,面向的核心场景是大规模 AI 训练、推理、高性能计算以及复杂的数据分析任务。很多人在了解这张卡时,最关心的一个问题就是H100 的算力到底有多少TOPS?要准确回答这个问题,必须先理解 TOPS 的含义,以及 H100 在不同精度和应用模式下的算力表现。

什么是 TOPS

TOPS 是 “Trillions of Operations Per Second” 的缩写,表示每秒可执行多少万亿次运算。它通常用于衡量 AI 芯片在整数或低精度推理任务中的计算能力,尤其常见于 INT8、INT4 等推理精度场景。需要注意的是,TOPS 并不是一个单一固定的数值,而是与计算精度、数据类型以及是否启用专用加速单元密切相关。

因此,当讨论 H100 的 TOPS 时,必须说明是在什么计算条件下得出的结果。

H100 架构对算力的影响

H100 基于 NVIDIA Hopper 架构,核心升级集中在三个方面:

第一是新一代 Tensor Core,支持更低精度的数据格式;

第二是 Transformer Engine,引入了 FP8 混合精度计算;

第三是对稀疏计算和大模型结构的深度优化。

这些改进使得 H100 在 AI 推理和训练中,单位时间内完成的运算量出现了数量级的提升,尤其是在低精度推理任务中。

H100 的 TOPS 算力范围

如果从 AI 推理常用的 INT8 精度来看,H100 的理论算力可达到约 4000 TOPS 左右。这是当前通用数据中心 GPU 中极为夸张的一个数字,远超前一代 A100.

在 INT4 精度下,如果模型和软件栈支持,H100 的等效 TOPS 还可以进一步提升,理论峰值可超过 8000 TOPS。不过需要强调,这类极低精度更多出现在高度优化的推理场景中,并非所有模型都能直接使用。

如果换成 FP8 精度,这是 H100 特有、为大模型设计的重要特性,其计算能力通常以 FLOPS 表示,但若折算成操作次数,其等效算力仍然远高于传统 FP16 或 FP32 模式。

星宇智算官网GPU显卡租用,不但实惠还可免费试用!

也就是说,从严格意义上讲,H100 没有一个唯一固定的 TOPS 数值,而是一个区间,取决于你运行的是哪种 AI 任务,以及所使用的精度类型。

TOPS 与实际性能的关系

虽然 H100 的 TOPS 数字非常亮眼,但在真实应用中,性能并不完全由 TOPS 决定。内存带宽、显存容量、通信能力以及软件优化同样重要。H100 在这些方面也都处于行业顶级水平,例如高带宽显存和强大的多卡互联能力,使其在大模型推理中可以持续输出高吞吐,而不是只在理论峰值下“昙花一现”。

在实际部署中,H100 的优势体现在:

推理延迟更低

单位功耗完成的推理任务更多

可以支持更大的模型一次性加载

在多卡并行时扩展效率极高

这些因素共同决定了 H100 的真实价值,而不仅仅是一行 TOPS 参数。

H100 TOPS 对比意义

如果把 H100 的 TOPS 放在整个 GPU 发展史中来看,它标志着 AI 计算从“通用浮点性能”为主,正式转向“面向模型结构和推理场景的专用算力”。在大模型时代,这种变化尤为重要,因为模型规模的增长已经远远快于传统算力的线性提升。

可以说,H100 的 TOPS 并不是单纯为了追求数字好看,而是为了在实际 AI 工作负载中,把这些运算能力真正转化为吞吐和效率。

FAQ:关于 H100 TOPS 的常见问题

1. H100 的 TOPS 是不是越高越好?

不完全是。TOPS 反映的是低精度运算能力,但如果模型不支持对应精度,或者内存和带宽成为瓶颈,那么实际性能提升会受限。

2. H100 的 TOPS 和 A100 相比提升多少?

在 INT8 推理场景下,H100 的 TOPS 大致是 A100 的数倍,属于跨代级别的提升,而不是简单的参数微调。

3. 训练模型也看 TOPS 吗?

训练阶段更关注 FLOPS 和显存容量,但 H100 的 FP8 计算能力让训练效率也得到了显著提升,只是通常不会直接用 TOPS 来描述。

4. 所有 AI 模型都能跑到 H100 的最高 TOPS 吗?

不能。只有经过优化、支持低精度计算并匹配硬件特性的模型,才能接近理论峰值。

5. H100 的 TOPS 在实际推理中能发挥多少?

在成熟的软件框架和推理引擎下,大型语言模型和视觉模型通常可以发挥出相当可观的比例,但仍然会低于理论最大值。

6. H100 是否适合中小企业使用?

从算力角度看非常强,但成本和功耗都很高,更适合云厂商、科研机构和大型 AI 公司集中部署。

7. 未来会有比 H100 TOPS 更高的显卡吗?

一定会有。TOPS 的增长趋势仍在持续,但未来更重要的可能是单位能耗、模型适配性以及系统级效率。