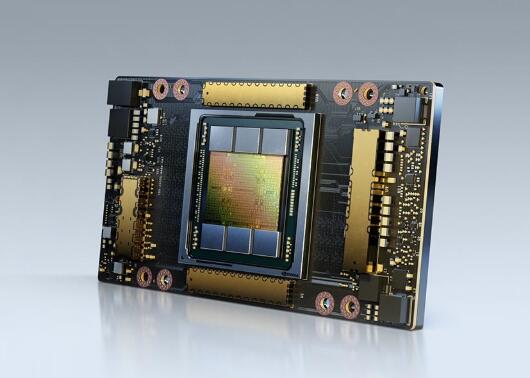

A100 显卡到底有多少显存?有人说是 40G,有人说是 80G,也有人一头雾水,甚至怀疑是不是还有其他版本。实际上,这个问题背后,不只是规格参数那么简单,而是关系到 模型规模、训练方式、成本控制和技术路线选择。

一、先给出明确答案:A100 有两个主流显存版本

直接说结论:

A100 显卡主要有两个主流显存版本:40GB 和 80GB。

这两个版本,都是官方标准形态,并不是第三方魔改或特殊定制。也正因为存在这两个版本,才会让很多人在查资料或选算力时感到困惑。

但需要注意的是:

它们的区别,远不止“多了 40G 显存”这么简单。

二、为什么 A100 会有 40G 和 80G 两种显存

A100 的设计初衷是面向数据中心,而不是普通消费级用户。数据中心的需求非常多样,有的任务看重算力,有的任务极度依赖显存容量。

40GB 版本,更偏向于:

常规深度学习训练

中等规模模型

推理与混合负载

80GB 版本,则明显针对:

超大模型训练

大批量并行计算

显存敏感型任务

换句话说,这是 NVIDIA 在同一代架构下,为不同使用场景准备的两种“工具”。

三、显存大小到底有多重要

很多新手会问:

“显存不就是能放多少数据吗?40G 不也挺大了?”

从普通显卡的角度看,40GB 的确已经非常夸张。但在 A100 所面向的场景中,显存往往是第一瓶颈。

星宇智算官网GPU显卡租赁,AI应用一键部署免费试用!

在深度学习中,显存主要用来存放:

模型参数

中间计算结果

梯度信息

输入数据批次

模型越大、batch size 越高、计算越复杂,对显存的需求就越高。一旦显存不够,哪怕算力再强,也只能“干瞪眼”。

四、40GB A100 适合什么场景

40GB A100 是目前使用非常广泛的版本。

它适合:

中大型模型训练

常规 NLP、CV 任务

企业级推理服务

算力与成本平衡场景

对于大多数团队来说,40GB 已经足以覆盖 80% 以上的 AI 工作负载。配合多卡并行或模型拆分,可以完成相当复杂的任务。

也正因为如此,40GB 版本在云平台上更常见,价格相对也更“友好”。

五、80GB A100 的意义在哪里

80GB A100 的存在,几乎就是为“大模型时代”量身定做的。

它的优势主要体现在:

可以容纳更大的模型

支持更大的 batch size

减少模型切分和通信开销

提高训练和推理效率

对于一些超大参数模型来说,40GB 显存可能连模型本体都放不下,更别说中间计算。而 80GB 显存,直接改变了可行性边界。

可以说,80GB A100 解决的不是“跑得快不快”,而是“能不能跑”。

六、显存越大,一定越好吗?

这是一个非常关键的问题。

答案是:

不一定。

如果你的任务本身:

模型规模不大

batch size 较小

显存占用低

那么 80GB 显存并不会带来明显收益,反而会增加成本。因为在云平台上,80GB A100 的小时价格通常高于 40GB 版本。

显存的选择,永远应该围绕“是否真正用得上”。

七、显存大小如何影响成本

在实际使用中,显存大小会直接影响:

GPU 租用价格

服务器整体成本

训练效率

项目周期

有时候,用 80GB A100 虽然单价更贵,但由于训练时间明显缩短,总成本反而更低。这也是为什么很多团队在预算评估时,不只看“每小时多少钱”,而看“任务跑完多少钱”。

八、A100 的显存和消费级显卡有什么不同

很多人会把 A100 的 40G 或 80G 显存,拿来和消费级显卡对比。

但需要注意的是:

A100 的显存是为持续高负载设计的

稳定性、带宽、并发能力更强

更适合长时间运行

因此,A100 的显存不仅仅是“容量大”,而是“可长期稳定使用的大容量”。

九、显存不是唯一指标,但是硬门槛

在显卡选择中,显存并不能代表全部性能,但它往往是最先卡住你的那条线。

算力不足,可以多跑一会;

显存不够,程序直接跑不起来。

这也是为什么在 AI 场景中,大家会先问显存,再谈算力。

FAQ:关于 A100 显卡显存的常见问题

Q1:A100 显卡是不是只有 40G 和 80G 两种?

A:是的,主流标准版本就是这两种。

Q2:40G 显存够训练大模型吗?

A:取决于模型规模。中大型模型可以,超大模型可能不够。

Q3:80G A100 一定比 40G 快三倍吗?

A:不一定。显存大小不等于算力倍增。

Q4:推理服务需要 80G 显存吗?

A:大多数推理任务不需要,除非模型非常大或并发极高。

Q5:个人开发者有必要用 80G A100 吗?

A:大多数情况下没有必要,成本压力较大。

A100 显卡多少 G 显存,这个问题的答案是清晰的:40GB 和 80GB。

但真正重要的,是你是否理解这两个数字背后的意义。

显存不是越大越好,而是刚好够用、用得高效,才是最优选择。在算力越来越昂贵的时代,理解显存,等于理解成本、效率和技术边界。