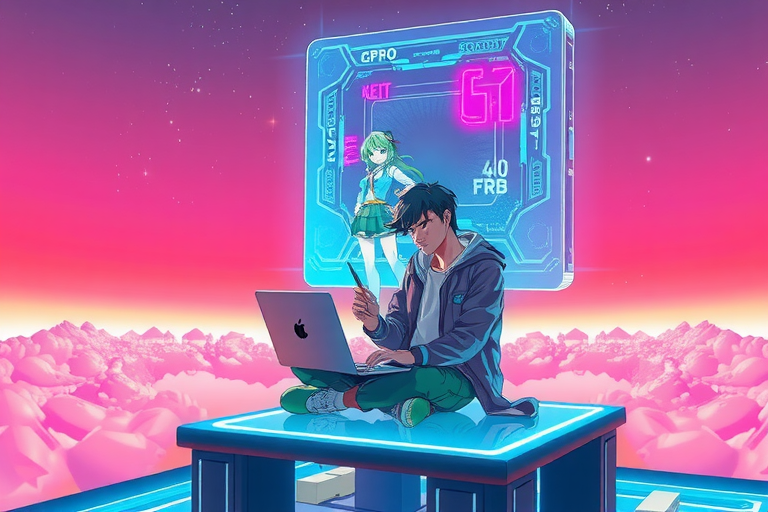

“一张4K二次元立绘,本地4090跑SDXL要8分钟,风扇像直升机起飞;转手用云算力,150张连跑只要47分钟,全程浏览器点点鼠标。”

——这是上周B站科技区一条10万+播放弹幕的真实画面,也是当下AIGC创作者最真实的缩影。

缺货、溢价、热浪,本地显卡的“三高”困局

过去18个月,NVIDIA RTX 4090从首发12999元一路被炒到2.5万元,仍一卡难求。更糟的是:

- 驱动兼容:Linux下PyTorch、CUDA版本稍有错位,WebUI就黑屏报错;

- 散热噪音:夏天室温30℃,显卡89℃撞温度墙,风扇狂飙60分贝,邻居直接敲门;

- 时间成本:一张高清SDXL图动辄1024×1536,本地出图8分钟,做一组角色立绘要通宵。

当“显卡=生产力”成为共识,买不到、买不起、用不好,就成了横在创作者面前的新三座大山。

云生万物,星宇智算把4090装进浏览器

星宇智算AI智算平台把上述痛点拆成三步,一次性打包解决:

- GPU服务器租用即开即用,4090/3090/A100等多规格可选,无需竞价抢购;

- AI应用一键镜像,内置Stable Diffusion XL 1.0+常用LoRA、ControlNet、ReActor等插件,浏览器点开即用;

- GPU云主机按分钟计费,关机即停,成本不到本地电费的三分之一。

换句话说,你只需打开网页,上传提示词,剩下的编译、驱动、散热、断电风险,全部交给云端。

WebUI直达,零命令行也能“批量出图”

传统Linux云主机,总要先ssh、conda、git clone、pip install一条龙,劝退99%的设计师。

星宇智算把SDXL做成“应用市场”里的一个图标,点击→启动→自动分配4090显卡→弹出WebUI地址,全程30秒。

支持功能:

- 多LoRA动态切换,无需手动改config;

- ControlNet OpenPose、Depth、Canny预装,直接拖图生图;

- 批量提示词队列,一次可塞500条prompt,后台自动跑;

- 出图自动保存到「持久化云盘」,关机换卡数据不丢,还能把模型丢给队友继续画。

实战:4K二次元角色150张,仅47分钟

测试环境:

– 实例规格:8核AMD EPYC + RTX 4090 24G(GPU服务器租用)

– 模型:SDXL 1.0 + 二次元LoRA(厚度线条2.5D)

– 分辨率:1024×1536,采样步数30,DPM++ 2M Karras

– 批尺寸:4,连续生成150张

结果:

– 总耗时47分钟,平均18.8秒/张;

– GPU温度稳定69℃,云端水冷机房无噪音;

– 费用:按0.99元/小时计,约0.78元跑完全程,折合每图0.005元。

本地同规格显卡,单张8分钟,150张需20小时,电费+折损≈30元,噪音、散热、占用工位另算。

云与本地,效率差距整整25倍。

开发者生态:不止绘画,整条AI工作流都加速了

星宇智算的定位不仅是“显卡替身”,而是AI智算及应用生态平台:

- 资源池:内置300+公共模型、120TB数据集,YOLOv8、Llama-3、ChatGLM3一键克隆;

- 云存储:跨实例共享,支持NAS协议,训练到一半关机,第二天换卡继续跑;

- 弹性集群:多卡A100可组分布式训练,最高10Gbps RDMA内网;

- 灵活计费:按小时、按天、包年包月三种模式,学生认证再享9折。

对高校团队,无需采购服务器,直接在线完成毕业论文里的YOLO实验;

对初创公司,把GPU云主机当临时算力池,业务峰值一过立即释放,现金流压力骤降;

对专业画师,浏览器就能跑SDXL+LoRA+ControlNet,MacBook Air也能出4K图,随时随地改稿。

0元试玩,30分钟白嫖4090

现在注册星宇智算,立送10元体验金,4090实例0.99元/小时,相当于免费跑30分钟,可出约100张高清图。

点击👉GPU服务器租用直达官网,手机号注册→选择「SDXL一键应用」→启动→复制WebUI地址,即可开画。

不用装驱动、不用刷BIOS、不用听风扇怒吼,把创意交给云端,把时间留给自己。

告别4090缺货焦虑,下一幅爆款立绘,也许就在你打开浏览器的第30秒后。